2026-04-29

Quand vos labels mentent : ce qu'une thèse de neurosciences m'a appris sur l'IA santé

Une leçon contre-intuitive d'une thèse de neurosciences

J'ai plafonné à 73 % d'accuracy pendant des mois sur un classifieur de Sharp Wave Ripples — ces oscillations hippocampiques liées à la consolidation mémoire.

Changé d'architecture. Scaled les données. Tuné les hyperparamètres. Rien ne bougeait.

Le vrai problème n'était pas le modèle. C'étaient les labels.

Le débordement biologique de la fenêtre temporelle

Mes labels étaient temporels : SWRs enregistrés avant apprentissage versus après. Sauf que le protocole tournait sur plusieurs jours consécutifs, et la consolidation mémoire ne s'arrête pas à la fin d'une session.

Les SWRs « avant » du jour J portaient encore les traces des apprentissages des jours précédents. Résultat : 12 à 13 % des signaux étaient structurellement mal étiquetés.

Pas une erreur d'annotation. Un débordement biologique sur la fenêtre temporelle du label.

Self-supervised : 73 % à 84 %

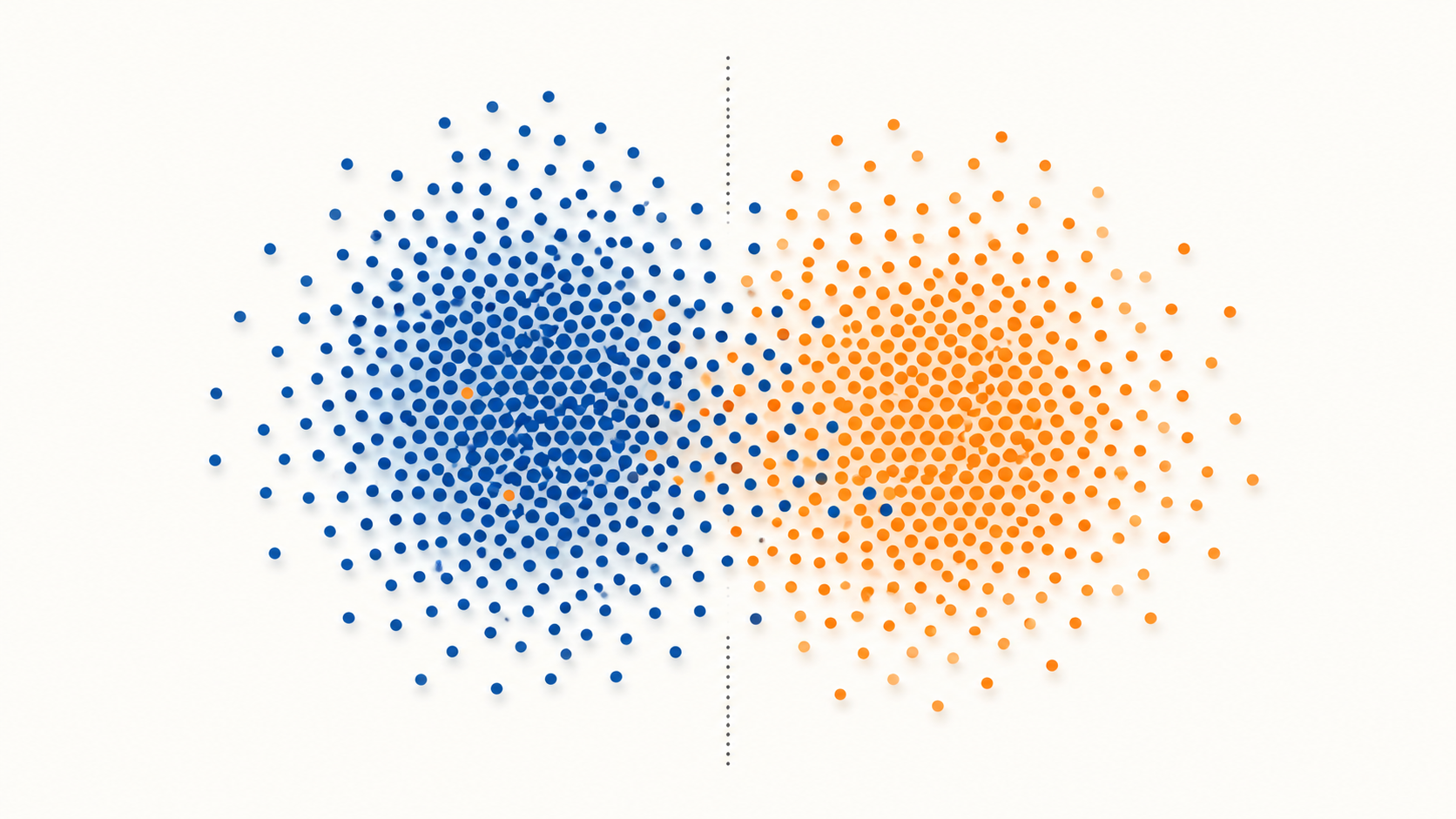

J'ai construit un pipeline self-supervised qui re-groupe le dataset selon la structure intrinsèque du signal, indépendamment de l'étiquette temporelle.

Ré-entraînement sur la même architecture, le même volume de données : 73 % à 84 %.

Pourquoi c'est partout en IA santé

Ce mécanisme dépasse largement les neurosciences. Il est structurel dès qu'on travaille sur du vivant :

- Phases de maladie qui se chevauchent — un patient « stade précoce » porte déjà la signature biologique du stade suivant

- Effets de traitement qui persistent — un patient « off-treatment » garde des biomarqueurs altérés des semaines après

- Comorbidités qui contaminent les cohortes contrôles — un sujet « sain » porte souvent une pathologie infraclinique non diagnostiquée

- Stratifications cliniques administratives — qui ne reflètent pas toujours la réalité biologique sous-jacente

Optimiser un modèle contre ces labels sans questionner leur structure, c'est valider une frontière administrative avec une métrique élégante.

Trois questions à poser avant d'optimiser un modèle

1. Que mesurent réellement vos labels ?

Un label « avant/après », « malade/sain », « répondeur/non-répondeur » est-il biologiquement net, ou résulte-t-il d'une convention temporelle, clinique ou administrative ? La réponse change ce qu'il est légitime d'optimiser.

2. Que dit la structure intrinsèque du signal ?

Avant d'entraîner un classifieur supervisé, faire tourner un clustering non-supervisé sur les features brutes. Si les clusters naturels ne s'alignent pas avec les labels, le modèle va apprendre la frontière la moins biologique des deux.

3. Quel est le taux acceptable de bruit de label ?

10 à 15 % de labels mal attribués peuvent suffire à plafonner un modèle bien avant sa capacité réelle. Un audit du bruit de label devrait précéder, et non suivre, le tuning d'hyperparamètres.

La métrique qui ment, et celle qui compte

Une accuracy stable sur un test set construit avec les mêmes labels biaisés que le train set ne valide rien. Elle confirme que le modèle reproduit le biais.

La vraie validation passe par des features intrinsèques, des sous-groupes définis indépendamment du label, ou un re-clustering self-supervised qui sert de second œil.

Si vous avez un projet d'IA santé où le modèle plafonne sans raison apparente — ou un pipeline où vous suspectez que les labels mentent — prenons 30 minutes pour en parler.